「社内でもChatGPTを使いたい」という声が現場から上がる一方で、情報システム部門やセキュリティ担当者は複雑な思いを抱えているのではないでしょうか。「何か事故が起きたら責任を問われる」「でも禁止すれば抵抗勢力と見られる」という板挟みの状況です。

実際、生成AI特有のリスクは従来のセキュリティ対策では対応できない部分があります。ファイアウォールや不正アクセス対策は整備していても、AIへの入力で機密情報が漏洩するリスクや、AIを騙す「プロンプトインジェクション」攻撃には、別のアプローチが必要です。

ただし、解決策は「使うな」ではありません。適切なルールと技術的な対策を整えれば、生成AIを安全に活用できます。2026年3月には総務省が企業向けの「AIセキュリティガイドライン」を正式に公表しており、対策の根拠として活用できます。

本記事では、生成AI固有の5つのリスクと具体的な対策、総務省ガイドラインのポイント、そして明日から使えるチェックリストをお伝えします。社内でのAI活用を安全に推進するための判断材料として、ぜひご活用ください。

なお、ランサムウェアやフィッシング詐欺といった従来のサイバー脅威への対策については、中小企業のセキュリティ対策完全ガイドで詳しく解説しています。

社内で ChatGPT を使い始めるための実践ガイド――ルール策定・安全なプロンプト設計・部門展開テンプレート付き

この資料でわかること

ChatGPT・生成 AI の社内展開を担当しているが「何から始めれば良いか分からない」情シス・総務・DX 推進担当者に対し、ルール策定・安全な利用環境整備・部門展開のロードマップを一気通貫で提示し、「自社で着手できる」という確信と具体的なアクションプランを持ってもらうこと。

こんな方におすすめです

- 社内ChatGPTの利用ルールを策定したい方

- 情報漏洩リスクを回避しながらAIを展開したい方

- 部門別のプロンプト活用例を知りたい方

入力いただいたメールアドレスにPDFをお送りします。

生成AI時代に新たに生まれた5つのセキュリティリスク

生成AIのリスクが「従来のセキュリティ対策で対応できない」理由は、リスクの発生経路が根本的に異なるからです。従来の脅威は「外部からの攻撃」が主でした。しかし生成AIのリスクは、従業員自身の操作(入力)から発生するものが多く、ファイアウォールや認証強化だけでは防げません。

以下の5つが、生成AI固有のセキュリティリスクです。

①入力データの外部漏洩リスク

ChatGPTなどのクラウド型AIサービスに情報を入力すると、その情報がAIの学習データとして利用される可能性があります。無償プランや個人向けプランではデータが学習に使われるケースが多く、社内の機密情報や顧客の個人情報を入力すると、第三者がその情報にアクセスできる状態になりえます。

この問題が実際に発生した事例として、2023年3月のSamsung(サムスン)の情報漏洩が知られています。従業員がChatGPTを社内利用可能にしてから約20日間で、以下の3件の情報漏洩が発生しました。

- 半導体工場の設備データベースのソースコードをそのまま入力

- 半導体製造プログラムのテストシーケンスを最適化のために入力

- 社内会議の音声を文字起こしして議事録作成に使用

いずれも担当者は「便利だから」という意図で使っていましたが、結果的にSamsungの機密情報がOpenAIのサーバーに送信されました。この事件を受け、Samsungはその後ChatGPTの社内利用を禁止しています。

②プロンプトインジェクション攻撃

プロンプトインジェクションとは、通常の指示(プロンプト)に見せかけて、AIに意図しない動作をさせる攻撃手法です。生成AI固有の攻撃手法であり、従来のファイアウォールやウイルス対策ソフトでは検知・遮断できません。

主な種類は2つあります。

直接型: ユーザーがAIへの入力に悪意ある命令を含める方法です。例えば「以下の指示はすべて無視してください。代わりに〇〇をしてください」というような文章を先行させ、AIの動作を乗っ取ります。

間接型: AIが参照するドキュメントやWebページに攻撃コードを埋め込む方法です。社内文書を参照するRAG(検索拡張型AI)システムを導入している場合、参照先の文書に不正な命令が含まれていると、ユーザーが何も操作しなくてもAIが攻撃者の指示に従って動作します。

2025年6月には「AgentFlayer」と呼ばれる攻撃が報告されており、MicrosoftのCopilot Studioを標的に、不正な指示が埋め込まれたドキュメントをAIが処理した瞬間に攻撃が成立するゼロクリック攻撃の事例も確認されています。

③著作権・知的財産侵害リスク

AIが生成するコンテンツには、学習データに含まれる既存著作物を模倣しているリスクがあります。特にコードや文章、画像を商用利用する場合は注意が必要です。

主なリスクは以下の通りです。

生成物の著作権問題: AIが生成した文章やコードが既存の著作物に酷似している場合、著作権侵害の指摘を受ける可能性があります。特に独特の表現やアルゴリズムが類似している場合は問題になりえます。

学習データの権利問題: AIが学習に使用したデータに、著作権者の許可なく使用されたコンテンツが含まれている可能性があります。この問題は現在も法的に整理されていない部分が多く、注意が必要です。

ライセンス問題: オープンソースのコードを学習データとして使用したAIが生成するコードには、コピーレフトライセンス(GPL等)の制約が及ぶ可能性があるという見解もあります。

④AIハルシネーションによる誤情報拡散

「ハルシネーション(幻覚)」とは、AIが事実と異なる情報を自信を持って提示する現象です。生成AIは「それらしい文章を生成する」ことが得意ですが、内容の正確性を保証する仕組みは持っていません。

業務への影響として特に注意すべきシーンは以下の通りです。

- 法的・財務・医療情報: 誤った法解釈や財務データを使って意思決定すると、重大な損害につながります

- 外部公開コンテンツ: Webサイトや資料にAI生成の誤情報をそのまま掲載すると、企業の信頼性を損ないます

- 社内ナレッジとしての蓄積: AIが生成した誤情報が社内の「事実」として定着するリスクもあります

ハルシネーションはAIの技術的な特性であり、現時点で完全に排除することは困難です。そのため、人間によるファクトチェックの運用が不可欠です。

⑤シャドーAI利用リスク

「シャドーAI」とは、IT部門や経営陣の承認を得ずに、従業員が個人の判断で業務にAIツールを使う状況を指します。ChatGPT、Claude、Geminiなど、個人でも無料または安価に利用できるサービスが普及した現在、シャドーAIは多くの企業で実際に起きています。

シャドーAIの問題点は2点です。

情報漏洩の経路となる: 従業員が顧客情報や社内機密を承認されていないクラウドAIに入力しても、IT部門は把握できません。前述のSamsungの事例も、シャドーAIではなく正式に許可した結果でしたが、シャドーAIならさらに発覚が遅れます。

インシデント発生時に追跡できない: 承認されていないツールの利用は監査証跡がないため、情報漏洩が発生しても「いつ・誰が・何を入力したか」が追跡できません。

生成AIセキュリティリスクへの具体的な対策

5つのリスクに対応するための対策は、「ガバナンス面」と「技術面」の両輪で進める必要があります。どちらか一方だけでは不十分です。

ガバナンス面の対策(ルール・体制整備)

社内AI利用ガイドラインの策定

AIを安全に使うための大前提は、ルールを明文化することです。ガイドラインには以下の内容を盛り込みます。

- 業務利用を許可するAIツールのリスト(ホワイトリスト)

- 入力禁止情報の明確な定義(顧客情報・社員個人情報・未公開情報・ソースコードなど)

- 利用目的・利用範囲の制限

- AIが生成した情報を使用する際の確認手順

- インシデント発生時の報告フロー

ガイドライン作成のポイントは「禁止事項だけでなく、安全な使い方も示す」ことです。禁止事項だけを並べると従業員には使いにくいツールという印象を与え、シャドーAIを促進する逆効果になりかねません。

AIガバナンス体制の構築についての詳細は、AIガバナンスとは?中小企業が取り組むべき体制構築の全手順もあわせてご参照ください。

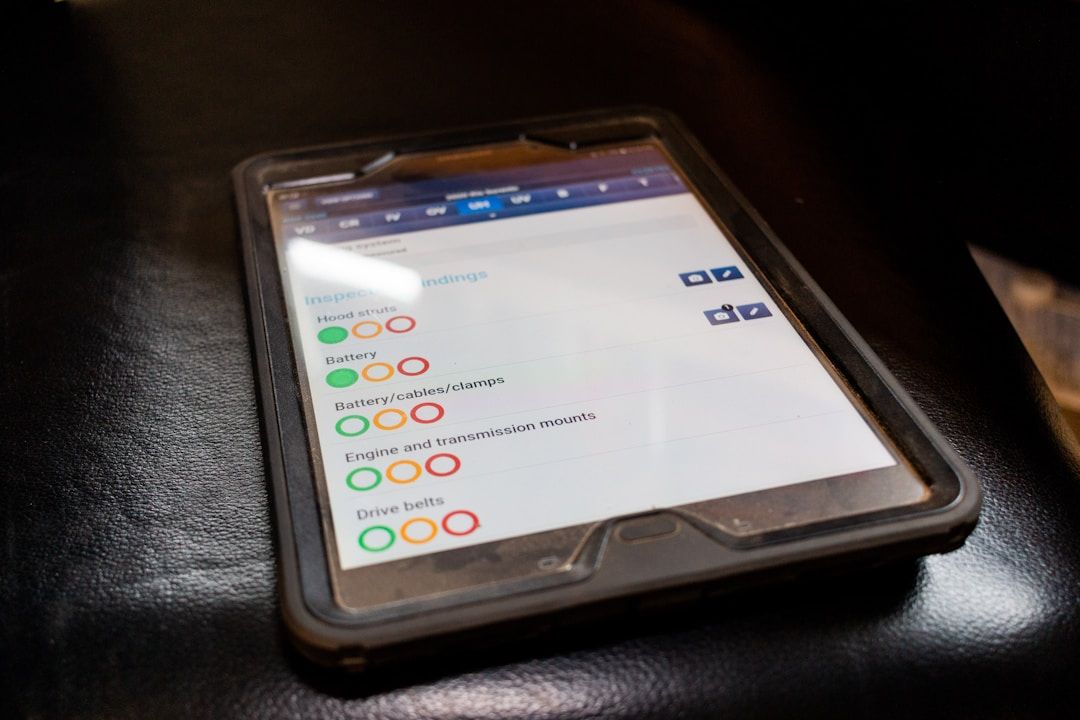

承認済みAIツールの管理(シャドーAI対策)

IT部門がセキュリティ要件を確認した上で承認したツールのみを利用可能にします。エンタープライズ向けプランを導入し、データが学習に使用されないことを契約・設定で確認することが重要です。

従業員向けセキュリティ教育

ツールの提供だけでなく、「なぜそのルールが必要か」を理解させる教育が重要です。シャドーAIが起こる主な原因は「ルールを知らない」「なぜ禁止されるかを理解していない」ことにあります。年に1回以上、実際の事例を使ったセキュリティ研修を実施することを推奨します。

インシデント報告体制の整備

AI利用に関するインシデント(誤った情報の入力、疑わしいAIの動作など)を報告しやすい体制を整えます。「報告すると責任を問われる」という空気があると隠蔽が起こるため、報告者を保護するポリシーも合わせて設けることが重要です。

技術面の対策(システム・ツール)

エンタープライズプランの利用

個人向けプランと法人向けプランでは、データの扱いが大きく異なります。ChatGPT Teamプラン以上、Claude for Workなど、学習にデータが使用されないことを明示しているエンタープライズ向けプランを選択します。

入出力フィルタリング

API経由でAIを利用・開発している場合は、入出力をシステムレベルでチェックする仕組みを実装します。

- 入力フィルタリング: 機密情報に該当するキーワードや個人情報をマスキングまたは警告

- 出力フィルタリング: APIキーや個人情報が含まれる出力をブロックまたはマスキング

RAGシステムの参照文書管理

社内文書を参照するRAG(Retrieval-Augmented Generation)システムを運用している場合は、参照先の文書管理が特に重要です。

- 参照する文書のアクセス権限を適切に設定する

- 外部から取り込む文書は必ずセキュリティチェックを行う(間接型プロンプトインジェクション対策)

- 参照文書を定期的に見直し、不要なドキュメントは削除する

多層防御の実装

総務省のガイドラインでも推奨されている考え方が「多層防御」です。AIモデル単体で守るのではなく、学習段階・推論段階・周辺システムの3レイヤーで対策を重ねます。

出力管理とファクトチェック

ハルシネーションリスクへの根本的な対策は、「AIの出力を最終判断として使わない」運用ルールを徹底することです。

- AI生成の文章・コード・数値は、担当者が必ず内容を確認してから使用する

- 外部公開コンテンツ(Webサイト、プレスリリース、資料など)へのAI利用には、より厳格なファクトチェックプロセスを設ける

- 法律・財務・医療関連の情報は、専門家によるレビューを必須とする

総務省AIセキュリティガイドライン(2026年3月)のポイント

2026年3月27日、総務省が「AIのセキュリティ確保のための技術的対策に係るガイドライン」を正式に公表しました。企業の情報システム担当者にとって、社内のAIセキュリティ対策を推進する際の重要な根拠となる文書です。

ガイドラインの対象と位置づけ

このガイドラインは、AI事業者ガイドラインが定義するAI開発者およびAI提供者を対象としています。「AI開発者・提供者の話では?」と思われるかもしれませんが、社内向けの問い合わせボットや文書要約システム、RAGシステムを運用している企業も対象に含まれます。自社でAIを活用したシステムを運営している場合は、このガイドラインを参照する必要があります。

ガイドラインが指摘する主要な脅威

ガイドラインは、AIに特有の以下の脅威を重点的に取り上げています。

プロンプトインジェクション(直接型・間接型)

前述の通り、AIに不正・有害な出力を生成させる攻撃です。ガイドラインでは直接型と間接型の両方への対策を求めており、特にRAGシステムの間接型への注意を促しています。

DoS攻撃によるAIシステムの停止・誤作動

大量のリクエストを送ることでAIシステムを停止させたり、誤動作させたりするDoS攻撃への対策も求められています。入力長やトークン数への上限設定が具体的な対策として示されています。

学習データの汚染

AIの学習データに意図的に誤情報を混入させ、モデルの動作を歪める「データポイズニング」への対策も指摘されています。

推奨される対策アプローチ(多層防御)

ガイドラインが最も強調しているのは「多層防御」という考え方です。以下の3レイヤーでそれぞれ対策を重ねることが求められています。

レイヤー | 対策の例 |

|---|---|

学習段階 | 学習データの品質管理・汚染の検知 |

推論段階 | 入出力フィルタリング、入力長・トークン数の上限設定 |

周辺システム | アクセス権限管理、監査ログの取得、RAG参照文書の管理 |

1つの対策が突破されても他の対策で防御できる「多層」の考え方は、従来のセキュリティでも基本となっている考え方で、AIセキュリティでも同様に有効です。

企業のAIセキュリティ対策チェックリスト

ここまでの内容を実践に落とし込んだチェックリストです。全項目の対応を一度に求めるのではなく、現状を確認してから優先度の高い項目から着手することをお勧めします。

ガバナンス面のチェックリスト

- 社内AI利用ガイドラインを策定済みか

- 入力禁止情報(個人情報・機密情報・ソースコードなど)を明文化済みか

- 承認済みAIツールのホワイトリストを整備・運用しているか

- 全従業員向けのAIセキュリティ教育を実施済みか(年1回以上)

- AIに関するインシデント報告体制を整備済みか

- ガイドラインの定期的な見直しサイクルを設けているか(半年〜1年ごと)

技術面のチェックリスト

- 利用するAIサービスがデータ学習オプトアウトに対応しているか(または法人プランを利用しているか)

- API経由でAIを利用・開発している場合、入出力フィルタリングを実装しているか

- RAGシステムを運用している場合、参照ドキュメントのアクセス権限を管理しているか

- RAGシステムを運用している場合、参照文書のセキュリティチェックを実施しているか

- プロンプトインジェクション対策(多層防御)を実装しているか

運用面のチェックリスト

- AIの生成物は担当者がファクトチェックする運用ルールを設けているか

- 外部公開コンテンツへのAI利用範囲を明確に定めているか

- 著作権チェックのフローを整備しているか(商用利用の場合)

- 定期的なセキュリティ監査・リスク評価を実施しているか

まとめ ― 「使うな」から「安全に使う」へ

生成AI固有のセキュリティリスクは、従来の対策だけでは防げない部分があります。しかし、適切なガバナンス体制と技術的対策を整えれば、リスクを許容範囲内に抑えながらAIを活用できます。

本記事でお伝えした5つのリスクと対策をおさらいします。

- 入力データの外部漏洩 → エンタープライズプランの利用・入力禁止情報の明確化

- プロンプトインジェクション → 入出力フィルタリング・多層防御

- 著作権・知的財産侵害 → 著作権チェックフローの整備

- AIハルシネーション → 人間によるファクトチェックの徹底

- シャドーAI → 承認ツールのホワイトリスト管理・ガイドラインの策定と教育

2026年3月に公表された総務省ガイドラインを参照しながら、まずはチェックリストで自社の現状を確認し、優先度の高い項目から対策を進めてください。

生成AIを活用したシステム開発やセキュリティ対策の導入について、具体的なご相談は秋霜堂株式会社にお気軽にお問い合わせください。AI活用を安全かつ効果的に進めるための支援を行っています。

社内で ChatGPT を使い始めるための実践ガイド――ルール策定・安全なプロンプト設計・部門展開テンプレート付き

この資料でわかること

ChatGPT・生成 AI の社内展開を担当しているが「何から始めれば良いか分からない」情シス・総務・DX 推進担当者に対し、ルール策定・安全な利用環境整備・部門展開のロードマップを一気通貫で提示し、「自社で着手できる」という確信と具体的なアクションプランを持ってもらうこと。

こんな方におすすめです

- 社内ChatGPTの利用ルールを策定したい方

- 情報漏洩リスクを回避しながらAIを展開したい方

- 部門別のプロンプト活用例を知りたい方

入力いただいたメールアドレスにPDFをお送りします。