「ChatGPTをCRMに組み込んでほしい」「社内ポータルにAI検索機能を追加したい」——このような経営陣からの指示を受けたとき、IT部門のリーダーはどこから手をつければよいでしょうか。

LLM(大規模言語モデル)のAPI連携は、技術的には既存のREST API連携と大きな違いはありません。しかし、LLM特有のコスト構造(トークン課金)、セキュリティ要件(データの学習利用)、性能の不確実性(ハルシネーション)など、従来のAPI開発とは異なる考慮事項が数多くあります。

こうした情報は「技術者向けの実装詳細」か「経営者向けの概要説明」に二極化しており、IT部門の担当者が「自社への適用方法を検討し、上司に計画を説明する」ための情報が不足しているのが現状です。

本記事では、主要LLM APIの比較・連携パターン・費用相場・セキュリティ設計・内製vs外注の判断基準まで、IT担当者が経営陣への説明に使える実務知識を一気通貫で解説します。

システム開発 完全チェックリスト――発注前・発注中・完了後の3フェーズで使えるチェック集

この資料でわかること

システム開発の外注・発注を初めて経験する担当者や、過去に失敗を経験した担当者が、発注プロセスの各フェーズで「何をチェックすべきか」を明確に把握できるようにする。

こんな方におすすめです

- 初めてシステム開発を外注する担当者

- 過去の発注で失敗を経験した方

- ベンダー選定の基準が分からない方

入力いただいたメールアドレスにPDFをお送りします。

LLM APIとは?既存システムへの組み込みが増えている理由

LLM APIとは何か(30秒でわかる概要)

LLM API(Large Language Model API)とは、OpenAI・Anthropic・Googleなどの事業者が提供する「AIの言語処理機能をHTTPリクエストで呼び出せるインターフェース」です。

自社でAIモデルを開発・運用するのではなく、クラウド上のモデルをAPIコールで利用する仕組みで、以下のような処理が実現できます。

- テキスト生成(チャット応答、文書要約、翻訳)

- 文書分析(情報抽出、分類、感情分析)

- コード生成・レビュー

- 画像・音声の処理(マルチモーダル対応モデル)

料金体系は「トークン課金」が基本です。トークンとはテキストを分割した最小単位で、日本語の場合は概ね1文字≒1〜2トークンで換算されます。入力したテキストのトークン数と、モデルが出力したトークン数の合計に対して課金されます。

なぜ2026年に既存システムへの組み込みが増えているのか

LLM APIが企業システムへの組み込みで急速に普及している背景には、主に3つの要因があります。

1. API価格の大幅な低下

2023年以降、主要LLM APIの価格競争が激化し、2026年時点では2023年比で平均80%以上のコスト削減が実現しています。月数十万円のコストが現実的な規模に収まるようになり、業務システムへの組み込みが費用対効果の観点でも成立するようになりました。

2. エンタープライズ向け機能の整備

当初はプロトタイプ向けが主流でしたが、2024〜2025年にかけてSLA保証・セキュリティ機能・コンプライアンス対応が整備されました。特にAzure OpenAI Serviceのような企業向けサービスにより、「機密データを外部に送れない」という大企業のセキュリティ要件に対応できるようになっています。

3. 業務システムへの需要拡大

AI活用の事例が積み重なり、「チャットボット」だけでなく、業務フォームの自動入力支援、社内文書の検索強化、コードレビュー自動化など、既存の業務システムとの統合パターンが確立されてきました。

主要LLM APIの比較と選び方(OpenAI/Claude/Gemini/Azure OpenAI)

4つの主要LLM API比較表(費用・性能・セキュリティ・SLA)

2026年4月時点の主要LLM API比較です(料金は参考値。最新情報は各公式サイトでご確認ください)。

OpenAI API | Claude API (Anthropic) | Gemini API (Google) | Azure OpenAI Service | |

|---|---|---|---|---|

代表モデル | GPT-5.4 | Claude Sonnet 4.6 | Gemini 2.5 Pro | GPT-5.4(Azure経由) |

入力料金(1M token) | $2.50〜 | $3.00〜 | $2.00〜 | GPT-5.4と同等+Azure基本料 |

出力料金(1M token) | $15.00〜 | $15.00〜 | $12.00〜 | GPT-5.4と同等+Azure基本料 |

日本語精度 | 高 | 高 | 高 | 高(OpenAIと同等) |

データ学習利用 | API利用は学習に非使用(設定可) | API利用は学習に非使用 | API利用は学習に非使用(設定可) | 学習に非使用(契約で保証) |

SLA | なし | なし | なし | 99.9%稼働率保証 |

企業向け機能 | 組織管理・ログ取得 | 組織管理 | GCP統合 | VNet統合・プライベートエンドポイント・コンプライアンス認証多数 |

向いているケース | 汎用・コスト重視 | 長文処理・指示への忠実性 | コスト重視・Google連携 | 高セキュリティ要件・金融・医療・官公庁 |

用途別の選び方ガイド

コスト重視の場合

処理量が多く、精度よりコストを優先するケースでは、Gemini 2.5 Flash(入力$0.30/1M token)などの軽量モデルを検討してください。バッチAPI(非同期処理)を活用すれば、さらに50%程度のコスト削減が可能です。

高い日本語精度が必要な場合

長文の社内文書処理や複雑な質問応答には、Claude Sonnet 4.6が指示への忠実性と日本語精度のバランスで評価されています。GPT-5.4も高精度ですが、料金は中〜高価格帯です。

セキュリティ要件が厳しい場合

金融・医療・官公庁など、データの取り扱いに厳格な規制がある業種では、Azure OpenAI Serviceが第一候補です。

Azure OpenAI Serviceが選ばれる理由(企業利用のセキュリティ要件)

Azure OpenAI Serviceは、OpenAIと同等のモデルをMicrosoftのAzureインフラ上で利用できるエンタープライズ向けサービスです。以下の点で一般のOpenAI APIとは異なります。

- データ保持なし: 入力データはリクエスト処理後に破棄され、学習に利用されません(契約で保証)

- プライベートエンドポイント: Azure仮想ネットワーク内での閉域接続が可能で、インターネット経由のデータ送信を回避できます

- SLA 99.9%: 稼働率のSLAが保証されており、基幹システムへの組み込みに対応できます

- コンプライアンス認証: ISO 27001、SOC 2 Type 2、HIPAA、PCI DSSなど多数の認証に対応

- 既存Azure環境との統合: Azure Active Directory(Microsoft Entra ID)での認証管理が可能

コストはOpenAI APIよりも若干高くなりますが、セキュリティ要件を満たすためのインフラ整備コストを考えると、エンタープライズ環境では総合的にコスト効率が高くなるケースが多くあります。

既存システムへのLLM API連携パターン3選

パターン1: バックエンド直接組み込み(シンプル・低コスト)

最もシンプルな連携方法です。既存のバックエンドサーバー(Node.js、Python、Java等)から直接LLM APIにHTTPリクエストを送信します。

[ユーザー] → [既存Webアプリ] → [バックエンドサーバー] → [LLM API] → [レスポンス]

メリット

- 実装が最もシンプルで、開発コストが低い

- 既存コードへの変更が最小限

- 小規模な用途(チャット補助、テキスト生成)に向いている

デメリット

- 複数のLLM APIを使い分ける場合にコードが複雑になりやすい

- APIキーの管理を各サービスで個別に対応する必要がある

- スケールアウト時のレート制限管理が煩雑になる

向いているケース: 利用箇所が1〜2か所に限定されるPoC、内部ツール、小規模サービス

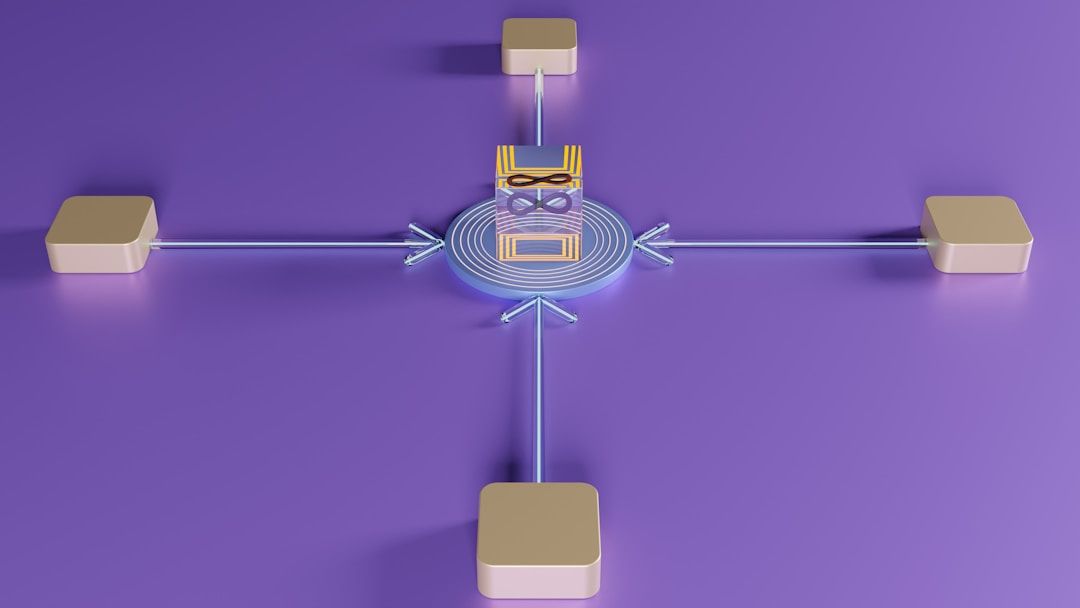

パターン2: API Gateway経由(複数モデル切り替え・セキュリティ強化)

LLM APIの前段にAPI Gatewayを配置するパターンです。AWS API GatewayやKongなどの既存のAPI GatewayにLLM API呼び出し機能を追加するか、LLM専用のプロキシ(LiteLLMプロキシ等)を導入します。

[複数のアプリ] → [API Gateway / LLMプロキシ] → [OpenAI API / Claude API / Gemini API]

↕

[ログ・認証・レート制限・コスト管理]

メリット

- 複数のLLM APIを一元管理でき、モデル切り替えが容易

- APIキーをGatewayで一元管理でき、セキュリティが向上

- コスト管理・ログ収集・レート制限をGatewayで集中処理できる

- 将来的なモデル変更・追加に柔軟に対応できる

デメリット

- Gatewayの構築・運用コストが追加で発生する

- 初期設定に一定の時間が必要

向いているケース: 複数サービスからLLMを利用する場合、本番システムへの組み込み、マルチクラウド環境

パターン3: LLMフレームワーク経由(LangChain/LiteLLMで複雑なワークフローを実現)

LangChainやLiteLLMなどのフレームワークを利用するパターンです。単純なテキスト生成を超えた複雑なワークフロー(複数ステップの推論、外部データベース参照、ツール呼び出し)が必要な場合に適しています。

LiteLLM: OpenAI API互換の統一インターフェースで100以上のLLMモデルを呼び出せます。主にAPIの標準化・コスト管理を目的とした軽量フレームワークです。

LangChain: LLMを使ったアプリケーション開発に特化したフレームワーク。RAG(検索強化型生成)、エージェント、メモリ管理など高度な機能を実装できます。

メリット

- 複雑なユースケース(RAG、エージェント、マルチステップ推論)を効率的に実装できる

- LLM切り替えが容易で、将来的な変更に対応しやすい

- コミュニティが大きく、日本語のドキュメントも充実してきている

デメリット

- フレームワーク自体の学習コストがある

- フレームワークのバージョンアップへの追従が必要

- シンプルなユースケースには過剰になりやすい

向いているケース: 社内ナレッジ検索(RAG)、複数ツールを組み合わせたAIエージェント、複雑な文書処理パイプライン

自社に合ったパターンの選び方

判断軸 | パターン1(直接組み込み) | パターン2(API Gateway) | パターン3(フレームワーク) |

|---|---|---|---|

利用箇所 | 1〜2か所 | 複数サービス | 複数サービス |

ユースケースの複雑さ | シンプル | シンプル〜中程度 | 複雑(RAG・エージェント等) |

開発期間 | 短い | 中程度 | 中〜長い |

運用コスト | 低 | 中 | 中〜高 |

まずどこから始めるか | PoC・小規模 | 本番展開 | 高度なユースケース |

コスト・レート制限・SLAの実務的な考慮事項

LLM APIのコスト構造を理解する(トークン課金の仕組み)

LLM APIのコストは「入力トークン数 × 入力単価 + 出力トークン数 × 出力単価」で計算されます。

トークンの目安(日本語):

- 1文字 ≒ 1〜2トークン

- 200文字の文章 ≒ 約200〜400トークン

- 1,000文字の長文 ≒ 約1,000〜2,000トークン

例えば、Claude Sonnet 4.6(入力$3.00/1Mトークン、出力$15.00/1Mトークン)で、「500文字の入力→200文字の出力」を処理した場合:

- 入力: 1,000トークン × $3.00/1M = $0.003

- 出力: 400トークン × $15.00/1M = $0.006

- 1リクエストのコスト: 約$0.009(約1.4円)

主要APIの料金比較と月額費用の試算方法

2026年4月現在の代表的なモデルの料金(参考値)は次の通りです(最新情報はLLM APIコストまとめをご確認ください):

モデル | 入力(1Mトークン) | 出力(1Mトークン) | 特徴 |

|---|---|---|---|

GPT-5 nano | $0.05 | $0.40 | 最安値帯・軽量タスク向け |

Gemini 2.5 Flash | $0.30 | $2.50 | コスト重視の中堅選択肢 |

GPT-5.4 | $2.50 | $15.00 | 高精度・汎用 |

Claude Sonnet 4.6 | $3.00 | $15.00 | 長文・指示忠実性 |

Claude Opus 4.6 | $15.00 | $75.00 | 最高精度・複雑タスク |

月額費用の試算例(月10万リクエスト、平均入力1,000トークン・出力500トークンの場合):

- GPT-5 nano: 入力$5 + 出力$20 = 月額約$25(約3,800円)

- Gemini 2.5 Flash: 入力$30 + 出力$125 = 月額約$155(約2.3万円)

- Claude Sonnet 4.6: 入力$300 + 出力$750 = 月額約$1,050(約16万円)

実際の費用はユースケースにより大きく異なります。本番導入前に、小規模テストでトークン消費量を計測した上で試算することを推奨します。

レート制限への対処とSLA比較

レート制限(Rate Limit)とは

LLM APIには「1分あたりのリクエスト数(RPM)」と「1分あたりのトークン数(TPM)」の制限があります。超過するとHTTP 429エラーが返されます。

主要APIのデフォルト制限例(プランにより異なる):

- OpenAI GPT-5系: Tier 1で RPM 500〜1,000、TPM 800,000〜2,000,000

- Claude: RPM 60〜1,000(プランにより異なる)

- Gemini: 無料枠は RPM 15、有料はプランにより異なる

対処法:

- 指数バックオフによるリトライ: 429エラー時に待機時間を増やしながらリトライする

- リクエストキューイング: キューを実装し、レート制限内で順次処理する

- プランのアップグレード: 利用量が増えたら上位プランへ移行する

SLAの比較:

OpenAI API | Claude API | Gemini API | Azure OpenAI | |

|---|---|---|---|---|

SLA | なし(ベストエフォート) | なし | なし | 99.9%稼働率保証 |

業務用途でダウンタイムが許容できない場合は、Azure OpenAI Serviceの選択を検討してください。

コストを抑える3つの実務テクニック

1. モデルの使い分け(ルーティング)

全リクエストを高精度モデルで処理するのではなく、処理内容に応じてモデルを使い分けます。例えば、定型的な分類処理は軽量モデル(GPT-5 nano等)、複雑な分析は高精度モデル(Claude Sonnet等)を使用する設計が効果的です。

2. プロンプトキャッシュの活用

同じシステムプロンプト(指示文)を繰り返し使用する場合、プロンプトキャッシュ機能を活用することで入力コストを大幅に削減できます。Claude APIではキャッシュ達成時に最大90%のコスト削減が可能です。

3. バッチAPI(非同期処理)の活用

リアルタイム応答が不要な処理(一括分類、レポート生成等)は、バッチAPIを活用することでコストを50%程度削減できます。OpenAI、Claudeともにバッチ処理オプションを提供しています。

システム開発 完全チェックリスト――発注前・発注中・完了後の3フェーズで使えるチェック集

この資料でわかること

システム開発の外注・発注を初めて経験する担当者や、過去に失敗を経験した担当者が、発注プロセスの各フェーズで「何をチェックすべきか」を明確に把握できるようにする。

こんな方におすすめです

- 初めてシステム開発を外注する担当者

- 過去の発注で失敗を経験した方

- ベンダー選定の基準が分からない方

入力いただいたメールアドレスにPDFをお送りします。

セキュリティ設計のポイント(APIキー管理・データ取り扱い)

LLM API利用時の3つのセキュリティリスク

リスク1: APIキーの漏洩

APIキーはクラウドへのアクセス権限そのものです。GitHubなどのコードリポジトリへの誤コミット、ログへの出力、ハードコーディングなどにより漏洩した場合、意図しない高額請求や不正利用が発生します。

リスク2: 機密データの送信

LLM APIは外部のクラウドサービスです。プロンプトに個人情報・機密情報・顧客データが含まれている場合、外部に送信されることになります。多くのAPIプロバイダーはAPI利用データを学習に使わないポリシーですが、通信経路上のリスクは排除できません。

リスク3: プロンプトインジェクション

ユーザーの入力をそのままLLMに渡す設計では、悪意あるユーザーがプロンプトを操作してシステムの指示を無効化したり、意図しない動作を引き起こす「プロンプトインジェクション」のリスクがあります。

APIキー管理のベストプラクティス

APIキーは以下の方法で安全に管理してください。

- 環境変数での管理: コードにAPIキーを直接記載せず、環境変数(.env)またはOS環境変数として管理する

- クラウドのSecret Managerを利用: AWS Secrets Manager、Azure Key Vault、GCP Secret Managerなどを使用し、コードから分離して管理する

- 最小権限の原則: 各サービスに必要最低限の権限のAPIキーを発行する

- 定期的なローテーション: APIキーを3〜6か月ごとに再発行・切り替える運用を設定する

- GitHubへの誤コミット防止:

.gitignoreでAPIキーを含むファイルを除外し、GitHubのSecret Scanningを有効化する

機密データを守るためのデータ取り扱いルール

データ分類に基づく送信可否の判断:

データ分類 | 例 | OpenAI/Claude/Gemini API | Azure OpenAI Service |

|---|---|---|---|

公開情報 | Webサイト掲載情報 | 送信可 | 送信可 |

社内情報(非機密) | 社内手続きマニュアル | 送信可(要確認) | 送信可 |

個人情報 | 氏名・住所・電話番号 | 匿名化・マスキング後のみ | 要社内規程確認 |

機密情報 | 顧客データ・財務情報 | 原則送信禁止 | 閉域接続で条件付き可 |

実装時の対策:

- プロンプトに含める前に個人情報をマスキング(氏名→「顧客A」等に置換)する

- 送信するデータの範囲を「最小限必要なもの」に限定する

- ログ出力時にはAPIレスポンスから機密情報を除去する

セキュリティ要件チェックリスト(経営承認用)

以下のチェックリストを整理することで、情報セキュリティ担当者・経営陣への説明資料として活用できます。

チェック項目 | 確認内容 | 対応状況 |

|---|---|---|

データ学習利用 | APIプロバイダーは入力データを学習に使用しないか | OpenAI/Claude/GeminiはAPIデータを学習に非使用(設定確認要) |

通信暗号化 | TLS 1.2以上での通信が保証されているか | 主要APIは全てTLS対応 |

APIキー管理 | キーの保管・ローテーション体制があるか | 上記ベストプラクティスに従い整備 |

データ保持期間 | プロバイダー側でのデータ保持期間は何日か | OpenAI API: リクエストデータは30日保持 / Azure: 設定により変更可 |

閉域接続 | 機密データを扱う場合、プライベートネットワーク経由で通信できるか | Azure OpenAI Serviceのプライベートエンドポイントで対応可 |

コンプライアンス | ISO 27001等の認証を取得しているか | Azure OpenAI: ISO 27001/SOC 2 Type 2等取得済み |

個人情報保護 | GDPR/個人情報保護法への対応状況 | プロバイダーの規約・社内規程の両面で確認要 |

内製 vs 外注の判断基準と費用感

内製が向いているケース・外注が向いているケース

内製が向いているケース

以下の条件が揃っている場合は、内製での対応が現実的です。

- 自社にPython/Node.js等でREST APIを扱える経験があるエンジニアがいる

- ユースケースが比較的シンプル(既存Webアプリへのチャット機能追加、テキスト生成等)

- 既存システムへの深い理解が必要(自社独自のデータ構造・業務ロジックへの依存度が高い)

- PoCや小規模なプロジェクトで費用を抑えたい

外注が向いているケース

以下に一つでも当てはまる場合は、外注を検討することを推奨します。

- 自社にLLM API連携の実務経験者がいない

- 基幹システム(ERP、CRM等)との連携が必要

- セキュリティ要件が厳しく、設計・レビューに専門知識が必要

- 開発期間が短く、内製では期日に間に合わない

- LLMの挙動不安定(ハルシネーション)への対処設計が必要

LLM API連携開発の費用相場(PoC〜本開発)

外注した場合の開発費用の目安は以下の通りです(会社規模・要件・ベンダーにより大きく異なります)。

フェーズ | 内容 | 費用の目安 |

|---|---|---|

PoC(概念実証) | 機能を絞ったプロトタイプ開発(1〜2か月) | 50〜200万円 |

小規模本開発 | 単機能・シンプルな連携(2〜4か月) | 100〜500万円 |

中規模本開発 | 複数機能・基幹システム連携(3〜6か月) | 500〜2,000万円 |

大規模本開発 | 複雑なワークフロー・セキュリティ要件強化(6か月以上) | 2,000万円〜 |

まずは50〜200万円のPoCから始め、効果を検証した上で本開発に進む「PoC先行型」の進め方が失敗リスクを低減します。

外注先を選ぶ際の5つのチェックポイント

- LLM API連携の実績があるか: 過去の事例(類似業種・類似ユースケース)を提示してもらい、具体的な実装経験を確認する

- セキュリティ体制: プライバシーマーク取得、情報セキュリティ方針の開示、機密保持契約(NDA)への対応状況を確認する

- LLM特有の問題への対処経験: ハルシネーション対策(RAG・バリデーション設計)、レート制限への対処、プロンプト設計の知識を確認する

- 保守・運用サポート: 本番導入後のモデル更新対応、障害時のサポート体制を確認する

- 費用の透明性: 見積もりに開発工数の内訳・変動要因・追加費用が発生する条件が明示されているかを確認する

活用できる補助金・支援制度(2026年最新)

デジタル化・AI導入補助金2026

2026年度から「IT導入補助金」が「デジタル化・AI導入補助金」に名称変更されました。AIを含むITツールの導入を支援する補助制度で、中小企業・小規模事業者が対象です。

- 補助対象: ソフトウェア購入費、クラウド利用料(最大2年分)

- 補助率: 補助対象経費の最大1/2〜(枠により異なる)

- LLM API連携開発: 要件を満たす場合、ソフトウェア・クラウド利用料部分が補助対象になりえます

詳細は中小企業庁の公式サイトでご確認ください。なお、補助金の活用については申請前に専門家(中小企業診断士・IT補助金申請支援業者等)に相談することを推奨します。

まとめ:LLM API連携開発を成功させるための次のアクション

本記事では、LLM API連携開発の全体像を「IT担当者が経営陣に説明できる」粒度で解説しました。最後に、次のアクションを3ステップで整理します。

ステップ1: 小規模PoCでAPIを選定する

まず自社のユースケースに最も近い用途でPoC(概念実証)を実施してください。費用は50〜200万円、期間は1〜2か月程度が目安です。PoCで「どのAPIが要件に合うか」「実際のトークン消費量はどれくらいか」「ハルシネーションの頻度と影響はどの程度か」を把握します。

ステップ2: セキュリティ要件を整理する

PoCと並行して、情報セキュリティ担当者と連携し、「どのデータをLLMに送れるか」「APIプロバイダーのセキュリティ要件は自社規程に合うか」を確認してください。本記事のセキュリティ要件チェックリストを参考に、経営承認に必要な情報を整理します。

ステップ3: 内製/外注を判断し、体制を構築する

PoCの結果とセキュリティ要件の整理をもとに、内製・外注の判断を行ってください。外注する場合は、LLM API連携の実績があるパートナーを選定し、まずPoC〜小規模本開発の範囲で協力体制を構築することが、リスクを抑えた進め方です。

LLM API連携開発は、適切な知識と計画があれば、既存のシステム開発と大きく異なるものではありません。まずは小さく始め、実績を積み重ねながら拡大することが成功への近道です。

自社への適用方法や費用感について相談したい方は、ぜひ無料相談をご活用ください。

秋霜堂株式会社について

秋霜堂は、Web開発・AI活用・業務システム開発を手がけるシステム開発会社です。要件定義から設計・開発・運用まで一貫してご支援しています。

システム開発のご相談や、自社課題に合った技術的アプローチについてお悩みの方は、お気軽にお問い合わせください。

システム開発 完全チェックリスト――発注前・発注中・完了後の3フェーズで使えるチェック集

この資料でわかること

システム開発の外注・発注を初めて経験する担当者や、過去に失敗を経験した担当者が、発注プロセスの各フェーズで「何をチェックすべきか」を明確に把握できるようにする。

こんな方におすすめです

- 初めてシステム開発を外注する担当者

- 過去の発注で失敗を経験した方

- ベンダー選定の基準が分からない方

入力いただいたメールアドレスにPDFをお送りします。