Kubernetesで複数のマイクロサービスを運用していると、あるタイミングで「サービス間通信の管理」がボトルネックになる瞬間が来ます。リトライロジック、タイムアウト設定、mTLS認証——これらをすべてのサービスのコードに書き続けることに、限界を感じていないでしょうか。

マイクロサービス数が10を超えてくると、こうしたインフラ関心事をアプリケーションコードで管理する負担は指数的に増大します。新しいサービスを追加するたびに同じ処理を実装し直し、設定変更のたびに全サービスを再デプロイする必要が生じます。この問題を解決するために生まれたのが「サービスメッシュ」です。

サービスメッシュは、アプリケーションコードを一切変えることなく、サービス間の通信制御をインフラ層に移譲できる仕組みです。聞こえはよいものの、「Istioを試そうとしたら設定の複雑さに圧倒された」「本当に自分たちの規模で必要なのか」という声もよく聞かれます。

本記事では、サービスメッシュが解決する課題・仕組みの本質・主要ツールの比較(Istio・Linkerd・Cilium)、そして2024年にGA(一般提供)を迎えたIstio Ambient Meshまで、技術的な背景から実務的な判断基準まで解説します。

サービスメッシュが生まれた背景——マイクロサービスの通信問題

マイクロサービス化でサービス間通信が指数的に増える

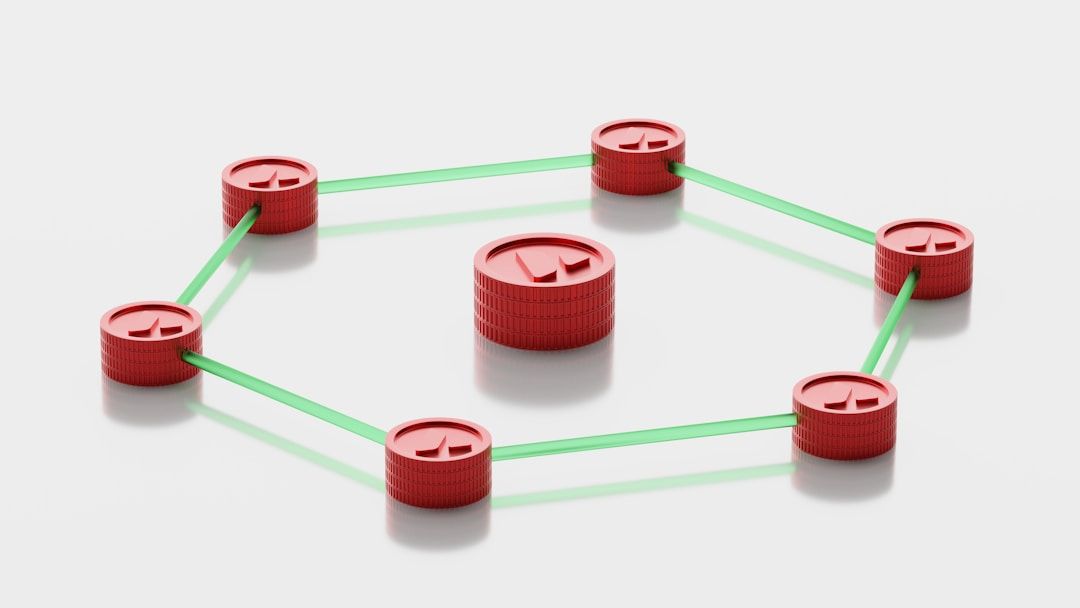

モノリシックなアプリケーションをマイクロサービスに分割すると、機能の独立性・スケーラビリティ・デプロイの柔軟性が得られます。その一方で、サービス間の通信経路は急速に増加します。

単純な計算ですが、サービスが2つなら通信経路は1本、5つなら10本、10つなら45本となります。実際のKubernetes環境では、ユーザー認証サービス・注文サービス・在庫サービス・通知サービス・決済サービスがそれぞれ通信し合い、そのすべての経路でレイテンシ管理・エラーハンドリング・セキュリティ設定が必要になります。

各サービスにインフラロジックを書き続ける限界

マイクロサービスアーキテクチャでは、各サービスが独自に通信ロジックを持つことが一般的です。しかし、サービス数が増えるにつれて次のような問題が浮上します。

リトライとサーキットブレーカー: HTTPリクエストが失敗したときの再試行ロジック、下流サービスが不安定なときに連鎖障害を防ぐサーキットブレーカーパターンを各サービスで実装する必要があります。

mTLS(相互TLS認証): サービス間通信を暗号化し、正規のサービスかどうかを相互に検証するmTLSは、セキュリティ要件として重要です。しかし証明書の発行・更新・配布を各サービスで管理するのは現実的ではありません。

分散トレーシング: リクエストが複数のサービスをまたいで処理される場合、どのサービスでどれだけの時間がかかったかを追跡するためのトレーシングヘッダーを全サービスで伝播させる必要があります。

これらのインフラ関心事を各サービスチームが個別に実装すると、コードの重複・実装の品質差・設定変更時の全サービス更新という問題が生じます。サービスメッシュはこの問題を解決するために設計されました。

サービスメッシュとは——通信管理をインフラ側に移す専用レイヤー

サービスメッシュとは、アプリケーションコードを変えることなく、サービス間の通信を制御するための専用インフラストラクチャ層です。

CNCF Glossaryの定義では「マイクロサービスアーキテクチャで動作するアプリケーションのサービス間の通信を管理するためのインフラストラクチャ層」と説明されています。

サイドカープロキシが全通信を仲介する仕組み

サービスメッシュの最も一般的な実装方式は「サイドカーパターン」です。

Kubernetesでは、1つのPodの中に複数のコンテナを配置できます。サービスメッシュは各アプリケーションPodに対して、サイドカープロキシと呼ばれる小さなプロキシコンテナを自動的に挿入します。

このサイドカープロキシがすべての通信を仲介します:

- サービスAがサービスBに通信しようとする

- リクエストはまずサービスAのサイドカープロキシに送られる

- サイドカープロキシがmTLS認証、リトライ設定、メトリクス収集などを処理する

- サービスBのサイドカープロキシがリクエストを受け取り、認証を検証してアプリに渡す

重要なのは、アプリケーションコードはこの仕組みを意識しなくてよいという点です。Kubernetes環境では、MutatingAdmissionWebhookというKubernetesの機能を使い、Podの作成時に自動でサイドカーが挿入されます。

データプレーンとコントロールプレーンの役割分担

サービスメッシュは2つの層から構成されます。

データプレーン(Data Plane): 実際の通信を処理する層です。各Podのサイドカープロキシがここに相当します。mTLS暗号化・復号、負荷分散、リトライ、メトリクス収集など、リクエストパスにある処理を担当します。代表的な実装はEnvoyプロキシです。

コントロールプレーン(Control Plane): データプレーンの全プロキシを一元管理する層です。サービスディスカバリー(どのサービスがどのIPで動いているか)、証明書の発行・更新、トラフィックポリシーの配布を担当します。Istioではistiodがこの役割を担います。

この分離により、設定変更をコントロールプレーンに対して行うだけで、クラスタ内の全プロキシに即座に反映できます。

サービスメッシュが提供する3つの機能領域

トラフィック管理——カナリアリリース・サーキットブレーカー・リトライ

サービスメッシュのトラフィック管理機能は、Kubernetesのネイティブ機能(Serviceリソース)では実現が難しい細かなルーティング制御を可能にします。

カナリアリリース: 新バージョンのサービスに対してトラフィックを段階的に増やしていく手法です。「全トラフィックの5%を新バージョンに送り、問題なければ50%、100%と増やす」という設定を、アプリコードを変えずにYAMLだけで実現できます。

サーキットブレーカー: 下流サービスへのリクエストが連続して失敗した場合、一定時間リクエストを止めて連鎖障害を防ぎます。タイムアウト・リトライ回数・連続エラー閾値をサービスメッシュのポリシーとして定義します。

負荷分散: ラウンドロビン・最小接続数・IP/ヘッダーに基づくスティッキーセッションなど、高度な負荷分散アルゴリズムをアプリ変更なしで設定できます。

セキュリティ——mTLS自動化とRBAC

mTLS(Mutual TLS)の自動化: サービスメッシュを導入すると、クラスタ内のサービス間通信をすべてmTLSで暗号化できます。証明書の発行・ローテーション・検証はコントロールプレーンが自動で行うため、各アプリチームが証明書管理を意識する必要がありません。

RBAC(ロールベースアクセス制御): 「サービスAはサービスBのAPIエンドポイントXのみにアクセスできる」という細かなアクセス制御をポリシーとして定義できます。ゼロトラストネットワークの実現に直結します。

可観測性——分散トレーシングとメトリクス収集

分散トレーシング: サービスメッシュは各リクエストに対してトレースIDを付与し、複数サービスにまたがる処理の流れを可視化します。JaegerやZipkinと連携することで、「注文処理が遅い原因が在庫サービスのデータベースクエリにある」といった問題を特定できます。

メトリクスの自動収集: プロキシがすべての通信を仲介しているため、サービスごとのリクエスト数・エラーレート・レイテンシが自動的に収集されます。PrometheusとGrafanaを組み合わせることで、アプリコードの計装なしにサービス間のSLI/SLOを監視できます。

主要なサービスメッシュ実装の比較——Istio・Linkerd・Cilium

2025年時点で実用的な選択肢となっている3つの実装を比較します。

項目 | Istio | Linkerd | Cilium |

|---|---|---|---|

プロキシ | Envoy(C++) | linkerd2-proxy(Rust) | eBPF(カーネルレベル) |

アーキテクチャ | サイドカー / Ambient Mesh | サイドカー | サイドカーレス(CNIとして統合) |

機能の豊富さ | 最多 | 中程度 | 中程度 |

運用の複雑さ | 高 | 低〜中 | 中(Kubernetes CNI知識が必要) |

リソース消費(プロキシあたり) | 40〜50MB(Envoy) | 約10MB | カーネル処理のため最小限 |

学習コスト | 高 | 低 | 中 |

適合チーム規模 | 大規模・SREチームあり | 小〜中規模 | クラウドネイティブ志向 |

Istio——機能最多だが運用コストは高い

Istioは最も機能が豊富なサービスメッシュです。データプレーンにEnvoyプロキシを使用し、トラフィック管理・セキュリティ・可観測性の全機能を網羅します。

コントロールプレーンのistiodは、サービスディスカバリー(Pilot)・証明書管理(Citadel)・設定配布(Galley)を統合した単一プロセスです。

課題は設定の複雑さです。VirtualService・DestinationRule・Gateway・PeerAuthentication・AuthorizationPolicyなど多くのCRD(カスタムリソース定義)を理解する必要があり、誤設定によるトラフィック断の事故リスクもあります。大規模な組織でSREチームが専任で管理できる環境向けです。

Linkerd——軽量・シンプル・小中規模向け

Linkerdはシンプルさと軽量さを徹底した設計のサービスメッシュです。Rustで書かれたlinkerd2-proxyは1プロキシあたり約10MBのメモリフットプリントで(Buoyant調査)、EnvoyベースのIstioと比べてリソース消費が大幅に少ないです。

2025年4月のベンチマーク(Linkerd公式)では、Istio Ambient Meshと比較してもp99レイテンシでLinkerdが優位な結果が示されています。

CRDの数もIstioより少なく、linkerd injectコマンドでサイドカーを挿入するだけで基本機能が使えます。SREチームを持たない小〜中規模のチームにとって、最初に試すサービスメッシュとして適しています。

Cilium——eBPFベースの次世代サービスメッシュ

CiliumはKubernetesのCNI(コンテナネットワークインターフェース)として動作しながら、サービスメッシュ機能も提供するユニークな実装です。

従来のサイドカーパターンではなく、LinuxカーネルのeBPF(extended Berkeley Packet Filter)を使ってネットワーク処理をカーネルレベルで行います。これにより、サイドカープロキシなしにサービス間の通信制御・mTLS・可観測性を実現できます。

eBPFとは、ユーザースペースのプログラムをカーネルのコンテキストで安全に実行できるLinuxカーネルの技術です。ネットワークパケットをユーザースペースにコピーすることなく処理できるため、サイドカーパターンに比べてレイテンシとCPU消費を削減できます。

Ciliumの可観測性ツール「Hubble」を使うと、サービスマップやネットワークフローの可視化がGUIで確認できます。KubernetesのCNIをすでにCiliumで運用している環境であれば、追加のサイドカー挿入なしにサービスメッシュ機能を段階的に有効化できる点が強みです。

選択基準——チーム規模・運用工数で判断する

実務での選択基準を以下に示します。

Linkerdを選ぶ場合:

- チームサイズが5〜20名でSREが専任でいない

- まずシンプルにmTLSと可観測性だけ使いたい

- リソース効率を重視している

Istioを選ぶ場合:

- 高度なトラフィック管理(カナリア・A/Bテスト)が必要

- SREチームがあり、設定の複雑さを管理できる

- 将来的にAmbient Modeへの移行も視野に入れている

Ciliumを選ぶ場合:

- CNIとしてすでにCiliumを採用している

- サイドカーレスアーキテクチャで始めたい

- eBPFによる高いパフォーマンスを重視する

サービスメッシュ導入前に確認すべきトレードオフ

レイテンシとリソースオーバーヘッドの実際

サービスメッシュ導入には明確なコストがあります。

レイテンシ: サイドカープロキシを経由することでリクエストに数ミリ秒のオーバーヘッドが加わります。Linkerd公式ベンチマーク(2025年4月)では、Linkerd自体のレイテンシオーバーヘッドはp50で0.8〜1.5msとされています。多くのサービスでは許容範囲内ですが、低レイテンシが求められる決済処理などでは考慮が必要です。

リソース消費: Istio(Envoyプロキシ)は1プロキシあたり40〜50MB程度のメモリを消費します。Podが100個あれば、プロキシだけで4〜5GB追加で必要です。クラウドコスト的に無視できない数字になることがあります。

導入を検討すべきサービス数・チーム規模の目安

RedHatのエンジニアリングブログ(Why and when to use a service mesh)では、「マイクロサービスが10以上で複雑な通信パターンがある場合に検討する」という目安が示されています。

より実務的な判断基準として以下を参考にしてください:

サービスメッシュが有効なサイン:

- サービスが10以上あり、それぞれが複数のサービスと通信している

- mTLSの実装を各サービスのコードで行うことに限界を感じている

- 障害発生時のトレーシングが困難で、原因特定に時間がかかっている

- カナリアリリースをKubernetesのネイティブ機能だけでは実現できていない

まだ不要かもしれないサイン:

- サービスが5つ以下で、互いの通信が単純なリクエスト・レスポンスのみ

- チームがKubernetesの基本的な運用にまだ慣れていない

- コンテナ数が少なく、サイドカーのリソースオーバーヘッドがコスト的に許容しにくい

サービスメッシュはKubernetesよりもさらに学習コストが高いツールです。Kubernetesの運用に慣れてから導入しても遅くはありません。

Istio Ambient Mesh——2025年のサービスメッシュはサイドカーレスへ

サイドカーパターンのリソース課題

サイドカーパターンには本質的な課題があります。サービスメッシュを必要としないPodにもプロキシが挿入されること、そしてすべてのPodにプロキシが存在するため、使わない機能のためにもリソースを消費し続けることです。

100PodのKubernetesクラスタで Istio(Envoy)を使う場合、プロキシだけで5〜10GBのメモリを消費します。これがIstioを「重い」と感じさせる最大の原因でした。

Ambient Meshの仕組みと2025年時点の成熟度

この課題を解決するために、Istioは2024年11月のv1.24でAmbient Mode(サイドカーレスモード)をGA(一般提供)として正式リリースしました(Istio公式ブログ)。

Ambient Meshは2層構造で動作します:

ztunnel(L4処理): 各KubernetesノードにDaemonSetとしてデプロイされる軽量プロキシです。mTLSとL4(TCP)レベルのトラフィック制御を担当します。Podごとではなくノードごとに1つしか存在しないため、100Podでも100ztunnelにはなりません。

Waypoint Proxy(L7処理): HTTPルーティング・カナリアリリースなどL7機能が必要なサービスにのみ、Namespace単位でデプロイされるオプションのコンポーネントです。すべてのサービスに挿入されるわけではないため、必要な部分だけリソースを使います。

Istio公式の計測では、100Pod構成でサイドカーモードでは5〜10GBかかっていたメモリ消費が、Ambient Modeでは200〜500MBまで削減されたとしています。

2025年時点ではztunnel・waypoint proxy・すべてのAPIが Stable(安定版)として本番利用可能な状態です。Istio 2025〜2026ロードマップ(Istio公式)では、サイドカーモードからAmbient Modeへの移行パスの整備が最優先事項として挙げられています。

新規にIstioを導入するチームであれば、Ambient Modeから始めることも現実的な選択肢になりました。